Des règles morales pour la maîtrise des véhicules autonomes ?

7 novembre 2018

sur

sur

Comment un véhicule autonome devrait-il réagir dans une situation où des vies sont en jeu ? Plusieurs millions de participants issus de plus de 200 pays ont répondu à une enquête, mise en ligne pour la première fois en 2014 par le MIT. Un certain nombre de dilemmes éthiques que le système de contrôle d'un véhicule autonome devra résoudre ont été présentés aux participants. Par principe, lorsqu'un accident est imminent, la voiture doit choisir l'une de deux alternatives létales possibles.

Les 40 millions de réponses reçues des 233 pays ont permis d'établir les règles que doivent appliquer les véhicules autonomes :

• Choisir d’épargner la vie d'un être humain par rapport à toute autre créature.

• Adopter un enchaînement d’actions permettant d'épargner le plus grand nombre de vies possibles.

• Épargner en priorité la vie des personnes les plus jeunes.

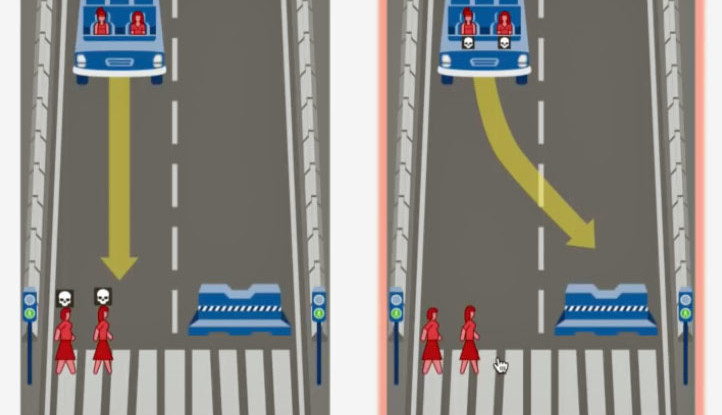

L'enquête elle-même est basée sur le résultat d'un jeu en ligne en plusieurs langues baptisé « Moral Machine » où les joueurs doivent indiquer leurs préférences face à certaines situations difficiles. Par exemple, celle-ci : un véhicule autonome doit-il épargner la vie d'un piéton respectueux du code de la route ou de celui qui traverse n’importe où ? La réponse a été assez nette, car la plupart des participants étaient favorable au premier, adepte des passages piétons.

Les véhicules autonomes ont besoin de règles éthiques - Vidéo : mit.edu

À ce stade, l'enquête a permis d'obtenir près de 40 millions de réponses individuelles, issues de 233 pays. Près de 500 000 participants ont également choisi de répondre à un questionnaire démographique pour préciser leur âge, leur niveau d'éducation, leur sexe et leur revenu, ainsi que leurs opinions politiques et religieuses. Les chercheurs ont constaté qu'il était impossible d'identifier des tendances significatives liées à ces caractéristiques, mais que le pays d'origine du participant jouait un rôle important dans la réflexion éthique. Les réponses issues de Taïwan, de Chine et de Corée du Sud (où les personnes âgées sont vénérées), par exemple, montrent une tendance à moins protéger la vie des personnes jeunes, en cas de risque mortel, contrairement à la France, la Grèce, le Canada et le Royaume-Uni où l'on préfère épargner leur vie.

Ces résultats sont importants et nous devons engager un dialogue mondial, avant que les ingénieurs programment les véhicules autonomes, pour veiller à ce que des préférences et des règles universelles soient incorporées dans les algorithmes de contrôle. Cette étude intitulée « The Moral Machine experiment » a été publiée sur le site de la revue Nature.

Les 40 millions de réponses reçues des 233 pays ont permis d'établir les règles que doivent appliquer les véhicules autonomes :

• Choisir d’épargner la vie d'un être humain par rapport à toute autre créature.

• Adopter un enchaînement d’actions permettant d'épargner le plus grand nombre de vies possibles.

• Épargner en priorité la vie des personnes les plus jeunes.

L'enquête elle-même est basée sur le résultat d'un jeu en ligne en plusieurs langues baptisé « Moral Machine » où les joueurs doivent indiquer leurs préférences face à certaines situations difficiles. Par exemple, celle-ci : un véhicule autonome doit-il épargner la vie d'un piéton respectueux du code de la route ou de celui qui traverse n’importe où ? La réponse a été assez nette, car la plupart des participants étaient favorable au premier, adepte des passages piétons.

À ce stade, l'enquête a permis d'obtenir près de 40 millions de réponses individuelles, issues de 233 pays. Près de 500 000 participants ont également choisi de répondre à un questionnaire démographique pour préciser leur âge, leur niveau d'éducation, leur sexe et leur revenu, ainsi que leurs opinions politiques et religieuses. Les chercheurs ont constaté qu'il était impossible d'identifier des tendances significatives liées à ces caractéristiques, mais que le pays d'origine du participant jouait un rôle important dans la réflexion éthique. Les réponses issues de Taïwan, de Chine et de Corée du Sud (où les personnes âgées sont vénérées), par exemple, montrent une tendance à moins protéger la vie des personnes jeunes, en cas de risque mortel, contrairement à la France, la Grèce, le Canada et le Royaume-Uni où l'on préfère épargner leur vie.

Ces résultats sont importants et nous devons engager un dialogue mondial, avant que les ingénieurs programment les véhicules autonomes, pour veiller à ce que des préférences et des règles universelles soient incorporées dans les algorithmes de contrôle. Cette étude intitulée « The Moral Machine experiment » a été publiée sur le site de la revue Nature.

Lire l'article complet

Hide full article

Discussion (0 commentaire(s))